Warum lokale KI-Systeme immer wichtiger werden

Das Problem mit Cloud-KI

Cloud-basierte KI-Systeme wie ChatGPT sind praktisch: Keine Installation, sofort nutzbar, immer aktuell. Aber es gibt Nachteile:

- Datenschutz: Ihre Daten verlassen das Unternehmen. Was passiert damit?

- Abhängigkeit: Wenn der Anbieter die Preise erhöht oder den Service einstellt, haben Sie ein Problem.

- Latenz: Jede Anfrage geht durchs Internet. Bei großen Datenmengen wird das langsam.

- Kosten: Pro API-Call. Bei hohem Volumen wird es teuer.

- Compliance: Regulierte Branchen (Gesundheit, Finanzen) dürfen Daten oft nicht extern verarbeiten.

Die Lösung: Lokale KI-Modelle

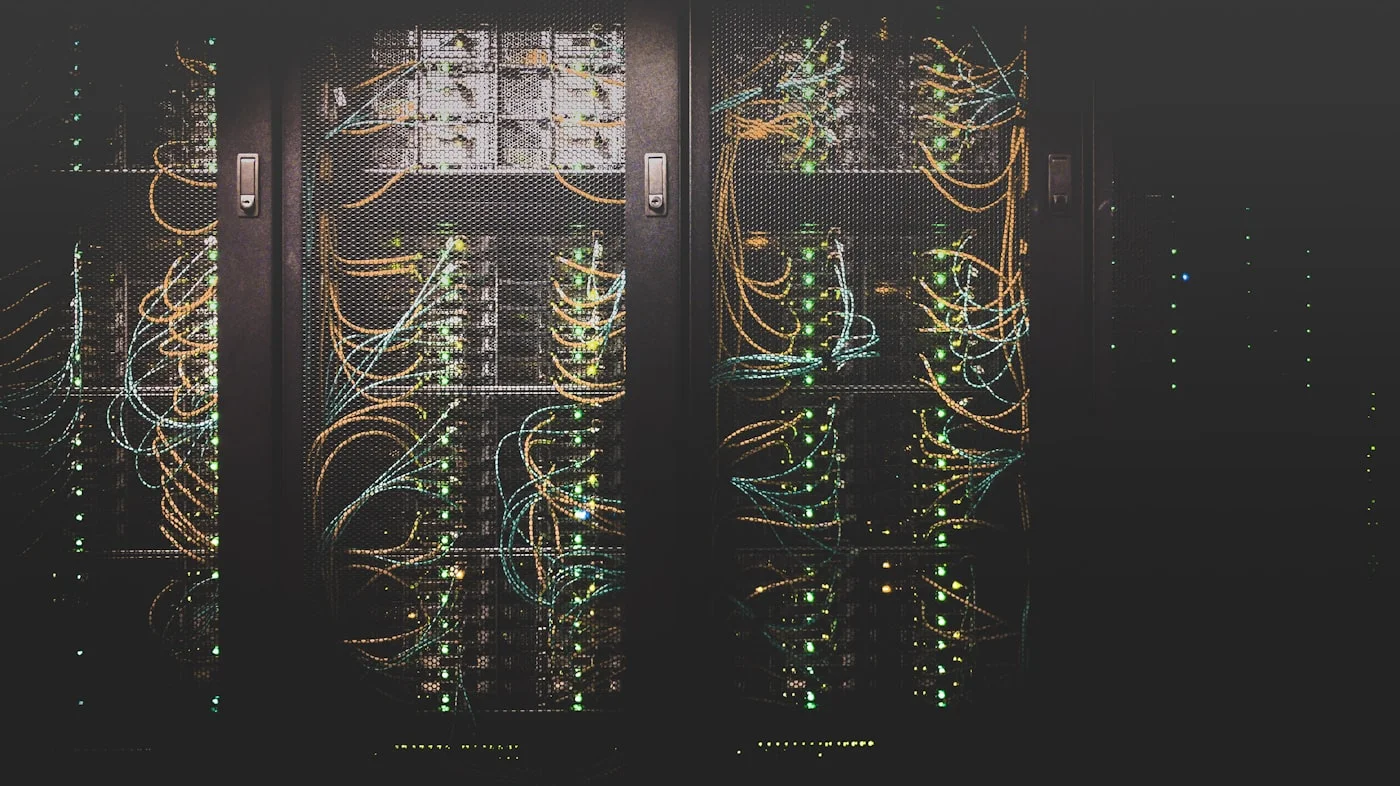

Lokale KI (auch: On-Premise AI oder Self-hosted AI) läuft auf Ihren eigenen Servern. Ihre Daten verlassen niemals Ihr Netzwerk.

Open-Source-Modelle machen es möglich

Dank Open Source gibt es heute leistungsfähige KI-Modelle, die jeder selbst betreiben kann:

- Llama 3 (Meta): Textgenerierung, fast so gut wie GPT-4

- Mistral (Mistral AI): Europäisches Modell, DSGVO-freundlich

- Phi-3 (Microsoft): Kleine, effiziente Modelle für spezielle Aufgaben

Wann macht lokale KI Sinn?

1. Sensible Daten

Wenn Sie mit personenbezogenen, medizinischen oder finanziellen Daten arbeiten: Lokale KI ist Pflicht.

2. Hohe Volumen

Wenn Sie täglich tausende API-Calls machen würden: Lokale KI ist günstiger.

3. Kontrolle

Wenn Sie das Modell anpassen wollen (Fine-Tuning auf Ihre Daten): Lokale KI gibt Ihnen Kontrolle.

Praktisches Beispiel: Wissenssystem

Ein mittelständisches Unternehmen wollte ein KI-Wissenssystem aufbauen. Mitarbeiter sollten in natürlicher Sprache nach internen Dokumenten suchen können.

Cloud-Lösung (abgelehnt):

- Alle Dokumente müssten zu OpenAI/Google geschickt werden

- Datenschutzrechtlich problematisch (Verträge, Kundendaten)

- Kosten: 5.000€/Monat bei geschätztem Volumen

Lokale Lösung (umgesetzt):

- Llama 3 auf eigenem Server

- Dokumente bleiben im Unternehmen

- Kosten: 15.000€ einmalig (Server) + 500€/Monat (Wartung)

- ROI nach 2 Jahren

Technische Anforderungen

Um lokale KI zu betreiben, brauchen Sie:

- Hardware: Server mit GPU (z.B. NVIDIA A100 oder günstiger: RTX 4090)

- Software: Ollama, LM Studio oder Custom-Setup

- Expertise: Jemand, der das System aufsetzen und warten kann

Kosten: Ab 10.000€ für ein Einstiegssystem. Enterprise-Setups: 50.000-100.000€.

Cloud vs. Lokal: Ein Vergleich

Cloud-KI (ChatGPT, Claude):

- ✅ Sofort nutzbar, keine Installation

- ✅ Immer aktuell

- ✅ Keine Hardware-Kosten

- ❌ Daten verlassen das Unternehmen

- ❌ Laufende Kosten (pro Nutzung)

- ❌ Abhängigkeit vom Anbieter

Lokale KI (Llama, Mistral):

- ✅ Daten bleiben im Unternehmen

- ✅ Volle Kontrolle

- ✅ Keine laufenden Kosten (nach Setup)

- ❌ Initiale Investment (Hardware, Setup)

- ❌ Wartung nötig

- ❌ Modelle müssen manuell geupdatet werden

Brauchen Sie ein lokales KI-System?

Wir helfen beim Setup: Hardware-Auswahl, Modell-Wahl, Integration.

Gespräch starten →Oder per E-Mail

Fazit: Hybrid ist die Zukunft

Die meisten Unternehmen werden beide Welten kombinieren:

- Cloud-KI für unkritische Aufgaben (Marketing-Texte, Brainstorming)

- Lokale KI für sensible Daten (Kundendokumente, interne Analysen)

Wer jetzt in lokale KI investiert, sichert sich Unabhängigkeit und Datenschutz. Gespr�ch starten ?